De verspreiding van misinformatie door OSN’s

De verspreiding van misinformatie door OSN’s

1 Inleiding

Voor het honours research seminar zullen we in deel II van de cursus proberen te achterhalen hoe nepnieuws herkent kan worden. Hiervoor willen we enkele berichten analyseren en vervolgens een algoritme trainen dat deze en andere nepnieuws berichten kan herkennen. In dit stuk zijn we de literatuur ingedoken om te ontdekken hoe nepnieuws zich verspreidt over sociale media. Eerst komt er wat achtergrond en context. Vervolgens zullen we de vraag beantwoorden en tot slot geef ik een advies voor de rest van het onderzoek.

2 Achtergrond

Nepnieuws of misinformatie kennen we eigenlijk al heel lang. Zo komt het al eeuwen in de vorm van spotprenten of propaganda. Machthebbers van vroeger hadden liever niet dat hun volk een slecht beeld over hen kreeg of goed nieuws ontving over hun tegenstanders. Dit geldt echter niet alleen voor de machthebbers, ook uitgevers van nieuws kunnen zelf hun vooroordelen in het nieuws terug laten komen.

Vorige eeuw nog was er een groep mensen die de macht had om een belangrijk nieuwsmedium te censureren. Redacteuren van kranten kunnen ervoor kiezen om een artikel die hun eigen land in een goed daglicht zet een prominentere plek te geven dan een artikel dat negatief is over hun land. Bovendien kan er ook voor gekozen worden een artikel helemaal niet te plaatsen.

Deze vorm van censuur kwam niet vaak voor, maar was ook niet ongekend. Zo is er een geval bekend van het amerikaanse Times Magazine waar een redacteur een artikel over communisme in de Spaanse Staat[1] weigerde omdat het “communisme in een te goed daglicht” zou zetten. (Gans H. , 1979) Soms blijft het onduidelijk of de censuur van redacteuren intentioneel is. Woordkeuze in artikelen is belangrijk, maar soms zijn er geen neutrale worden beschikbaar. Zoals over de jonge amerikaanse mannen die niet in de Vietnamoorlog wilden vechten; ‘De media had ze ontwijkers, vermijders of verzetters kunnen noemen.’ [2] Hierbij zetten de eerste twee termen de mannen in een kwaad daglicht en de laatste term zet de mannen in een goed daglicht. De woordkeuze hier is van groot belang voor het beeld dat de lezer van de mannen krijgt.

3 Misinformatie en OSN’s

Vandaag de dag hebben we minder met deze problemen te maken. We maken massaal gebruik van online sociale netwerken (OSN’s) waarbij er niet één of een kleine groep redacteuren aan de top staat die bepaald wat gepubliceerd mag worden en hoe het gepubliceerd mag worden. Toch is misinformatie nog steeds een probleem. Door de verandering van het medium ‘gedraagt’ misinformatie zich anders. Iedereen is een potentiële bron én is een onderdeel van de verspreiding ervan. Zoals Charley heeft uitgelegd zijn useful idiots en trollen normale gebruikers die bewust of onbewust nepnieuws verspreiden. Echter zullen we zien dat niet iedereen even belangrijk is voor de verspreiding van die nepnieuws.

Door OSN’s kan misinformatie omtrent covid-19 (het coronavirus) vrijspel krijgen om zich snel te verspreiden. Om dit tegen te gaan kunnen we uitzoeken hoe informatie zich online verplaatst. Als we weten hoe misinformatie zich verspreidt, kunnen we deze inzichten gebruiken om ervoor te zorgen dat de juiste informatie zich over een OSN verspreid voordat de misinformatie dat doet.[3] Ook is misinformatie met een hoge nauwkeurigheid te herkennen aan de manier waarop het zich verspreid. (Castillo, Mendoza, & Poblete, 2011) In tijden waarin nepnieuws zich sneller verspreidt dan het virus is het belangrijk om te weten hoe misinformatie zich verspreidt door en tussen OSN’s. We willen weten wat de gevaren zijn en wat de grote partijen zoals de OSN-platformen en overheden en wij als studenten kunnen doen om nepnieuws effectief tegen te gaan. Deze vragen zullen in dit deel van het literatuuronderzoek worden beantwoord.

4 Het gevaar van nepnieuws in medische context

Terugkijkend naar voorgaande epidemieën zijn er een paar dingen die terugkomen. Voor HIV/AIDS, Ebola en de varkensgriep ging er misinformatie rond. Er gingen verhalen rond dat ze niet echt waren, of gemaakt waren door een overheid of de elite om een bepaald deel van de bevolking te verzwakken of uit te roeien. (Mian & Khan, 2020) (Stern, 2014)

In 2014 heeft dit ervoor gezorgd dat er in Guinee onverwachts een tweede golf aan Ebola patiënten kwam. De bewoners van het platteland vertrouwde de buitenlandse hulpverleners niet. Er deden geruchten de ronde dat ‘de rebellen in de gele pakken’[4] (Figuur 1) er niet waren om te helpen, maar juist de oorzaak van de vele slachtoffers waren. Dit had tot gevolg dat de bewoners op het platteland zich niet meer meldden als Ebola-patiënt. Toen er drie weken[5] later er zich geen nieuwe patiënten meer hadden gemeld, zagen de hulporganisaties dit als hét teken dat de uitbraak voorbij was en de hulporganisaties begonnen hun aanwezigheid af te bouwen. Niet veel later werden de artsen overspoeld door nieuwe patiënten.

Uit wantrouwen hadden deze nieuwe patiënten zich niet eerder gemeld. Ondertussen hadden ze helaas wel andere landgenoten besmet. Als gevolg steeg het aantal bevestigde nieuwe ebolagevallen in een maand tijd naar 290 om vervolgens bijna een jaar later een nieuwe piek te bereiken op 1120 patiënten. Dit terwijl de oude piek op slechts 120 patiënten lag. (US Centers for Disease Control and Prevention, 2019) Het is niet ondenkbaar dat de Ebola uitbraak minder dodelijk geweest zou zijn indien deze mensen beschikking hadden over de juiste informatie.

Ook over het coronavirus gaan er nu vergelijkbare verhalen rond. Het zou bijvoorbeeld gemaakt zijn in een lab als wapen, of het virus bestaat niet eens en is een verzinsel van een overheid om het volk in bedwang te houden. (Mian & Khan, 2020) Minder sensationeel maar wellicht wel schadelijker zijn de verhalen over curen voor het virus. Zo ging er zonder bewijs rond dat vitamine C, het eten van knoflook en een chloordioxide oplossing de verspreiding van het virus zouden kunnen tegen gaan. (Mian & Khan, 2020) Naast dat deze theorieën mensen een onterecht gevoel van veiligheid geven, kan het ook gevaarlijk zijn voor individuen die deze theorieën geloven. Het laatste type gerucht heeft zeker een dode teweeg gebracht. (The Guardian, 2020)

Omdat een groot deel van de misinformatie over het coronavirus zich online verspreidt willen we graag in beeld brengen hoe dit gebeurt. Waar komt deze informatie vandaan en hoe kan het gestopt worden? Hiervoor zullen we kijken naar misinformatie op online social networks (OSN’s) en enkele onderzoeken die de verspreiding van (mis)informatie op deze netwerken beschrijft.

Figuur 1: de gele pakken van hulpverleners in Guinee tijdens de Ebola uitbraak.

Bron: Dominique Faget/AFP

5 Misinformatie op OSN’s

Online vormen mensen (gebruikers) knopen in een groot netwerk dat zich huisvest op verschillende OSN’s (de platformen) en losse webpagina’s. Misinformatie bevat vaker weblinks of URL’s die verwijzen naar deze pagina’s dan andere berichten. (Resende, et al., 2019) Hoe informatie zich online verspreidt, kan worden beschreven aan de hand van twee wetmatigheden. De power law omschrijft hoe hoe het komt dat informatie van sommige pagina’s, blogs en forums wel wordt opgepikt en gedeelt en andere niet. Assimilatie beschrijft hoe vooroordelen informatie kan veranderen in misinformatie wanneer het vaak gedeelt wordt.

6 Power law: niet elke bron van misinformatie is gelijk

Het world wide web (WWW) is niet een uniform verdeeld netwerk. Op het internet blijven gebruikers, binnen het WWW, vaak binnen eigen subnetwerk wat een echokamer kan vormen. Dit komt doordat pagina’s geneigd zijn om soortgelijke pagina’s te linken. Dit wordt preferential attachment genoemd en wordt omschreven door de power law.

Pagina’s met veel binnengaande verbindingen (weblinks) hebben volgens de power law een grotere kans om nieuwe weblinks te krijgen dan pagina’s die nauwelijks binnengaande verbindingen hebben. Goed verbonden pagina’s zullen zo steeds beter verbonden worden. Een nieuwe pagina zal waarschijnlijker linken naar ‘facebook.com/’, wat goed gelinkt is door de like-knop die op veel websites te vinden is, dan naar ‘ditjesendatjes.nl/puzzel/’ waar minder weblinks naar toe wijzen. De kans dat een nieuwe pagina A een weblink naar pagina B maakt is, volgens deze wetmatigheid, dus afhankelijk van hoeveel weblinks er al naar pagina B zijn. (Faloutsos, Faloutos, & Faloutsos, 1999) Hierdoor is er slechts een klein aantal goed gelinkte pagina’s die invloed hebben op de informatie op alle pagina’s.

Deze versie van de power law gaat er impliciet vanuit dat de makers van de pagina’s een geheel beeld hebben van het internet. Dit is echter erg onwaarschijnlijk. Het is niet alsof de maker van een pagina het hele internet afgaat om te zien waar de meeste weblinks naar toe wijzen om vervolgens naar de meest voorkomende pagina een weblink te maken en zijn informatie hiervan over te nemen. Die makers van de pagina’s zijn voor een belangrijk deel (direct of indirect) mensen[6]. Vandaag de dag zijn de gebruikers van het web, ook de makers van de inhoud van de pagina’s. Deze gebruikers hebben niet een compleet beeld van het internet en zullen hun keuze om pagina B of C te linken niet laten afhangen van het hele internet.

Wat wel terug te zien is ‘soort zoekt soort-achtige’ omstandigheden. Pagina’s hebben een grotere kans om weblinks te maken die verwijzen naar pagina’s die over hetzelfde onderwerp gaan. (Mossa, Barthélémy, Stanley, & Nunes Amaral, 2002) Zo zal een pagina over fietsbanden sneller een weblink maken naar een pagina over verschillende soorten ventielen dan over verschillende soorten roofvogels. Bezoekers van deze pagina zullen vanzelfsprekend eerder de pagina over ventielen bezoeken dan die over roofvogels. Als we spreken over fietsbanden, ventielen en roofvogels dan maakt dat niet zoveel uit. Als we echter over ‘healthy lifestyle tips van Sanne’ hebben, dan is het minder fijn dat deze paginabezoekers naar ‘Voorkom het Coronavirus met deze vijf maaltijden’ stuurt in plaats van ‘informatie over het coronavirus: symptomen en hoe was je goed je handen’.

Wetenschappelijke bladen verwijzen vooral naar populaire wetenschappelijke bladen en persoonlijke blogs vooral naar populaire persoonlijke blogs. Doordat bezoekers met de ene interesse niet gauw een pagina zouden opzoeken met nuttige informatie die niet in hun niche past, zullen ze naar die informatie geleid moeten worden via die niches, maar die niches linken vooral naar zichzelf. Hierdoor wordt het echokamereffect jaar op jaar groter. De pagina’s nemen informatie van de grote pagina’s in hun niche over en in sommige gevallen helaas zonder controle.

Wanneer OSN’s hierbij worden betrokken kan een false fact echt viraal gaan. Zoals Charley eerder beschreef spelen bots en trolls een belangrijke rol in het verspreiden van onwaarheden. Bots kunnen binnen echokamers snel korte emotionele berichten doen rondgaan. De gebruikers die al in deze niche zitten hebben weinig informatie nodig over berichten die in een lijn staat met hun interesses. Wanneer ze een bericht zien wat overeenkomt met hun wereldbeeld zullen ze het al snel geloven en delen. Trolls spelen juist een belangrijke rol in het overtuigen van mensen buiten deze niches. Gebruikers buiten een echokamer hebben vaak meer informatie nodig om hun berichten als waar aannemen. (Andrews, 2019) Menselijke trollen kunnen deze extra informatie geven.

Bovendien geldt de power law ook voor gebruikers in sociale netwerken. Er is slechts een klein aantal gebruikers die de bron is van de meest gedeelde misinformatie. (Andrews, 2019)[7] Deze kleine groep gebruikers bepaald het ‘succes’ van een nepnieuws bericht. Vaak zijn dit de mensen met veel (online) aanzien en volgers. Gebruikers die in hetzelfde subnetwerk zitten zullen sneller een bericht delen van een van deze invloedrijke verspreiders dan van een willekeurige ander iemand in hetzelfde subnetwerk. Het maakt hierbij niet uit of deze gebruikers zelf deze invloedrijke mensen volgen of niet. Als zij en hun volgers dezelfde interesse hebben dan is de kans groot dat het bericht hen bereikt.

7 Assimilatie: berichten kunnen veranderen

Wat niet vergeten mag worden is dat niet elke bericht met misinformatie ter wereld komt als onwaar. Informatie kan een OSN als correcte informatie binnen komen en na aantal keren delen zijn veranderd in misinformatie. Dit kan komen door assimilatie. Dat is hetzelfde fenomeen dat ervoor zorgt dat roddels uit de hand lopen en in het doorfluisterspel[8] het uiteindelijke verhaal niet overeenkomt met het oorspronkelijke verhaal. Dat blijkt ook uit een roddel experiment van (Allport & Postman, 1947) daaruit bleek dat uit de helft van chains aan mensen het oorspronkelijke verhaal aangepast werd.

Door (Silverstein, 1987) wordt vermoed dat dit ook een rol speelt in het verspreiden van misinformatie. Mensen vullen de gaten van het verhaal in met wat volgens hun wereldbeeld het beste past. Soms wordt er iets toegevoegd aan een verhaal, soms wordt er iets weggelaten of veranderd. Na een aantal keer dit proces door te zijn gegaan kan een bericht totaal veranderd zijn. Met name op messenger-OSN’s zoals Telegram, Signal en Whatsapp is dit een probleem. Zo hebben (Resende, et al., 2019) in hun onderzoek naar misinformatie in WhatsAppgroepen rekening moeten houden met assimilatie. Om de verspreiding van nepnieuws bij te houden beschouwde ze berichten die erg op elkaar leken als hetzelfde bericht[9]. Later volgt meer over dat onderzoek.

Door de power law weten we dat pagina’s geneigd zijn om informatie over te nemen en dat gebruikers sneller informatie delen die al populair is in de eigen (online) gemeenschap. Dit heeft tot gevolg dat informatie die binnen een gemeenschap als ‘waar’ wordt beschouwd sneller en vaker wordt gedeelt dan informatie van buiten de eigen gemeenschap. Bovendien zijn slechts een paar van de gebruikers in het netwerk verantwoordelijk voor het grootste deel van de misinformatie.

Ook weten we dat door assimilatie deze vaak gedeelde informatie kan veranderen. Zo kan een bericht met echt nieuws na propagatie veranderen in een bericht met nepnieuws. Pas als dit bericht een van de invloedrijke mensen in een gemeenschap bereikt en door hen gedeelt wordt krijgt deze pas echt voet aan de grond . Dit is ook terug te zien in de resultaten van de volgende twee onderzoeken naar misinformatie op Facebook en WhatsApp.

8 Verschillen en overeenkomsten in informatie en misinformatie in OSN’s

Uit het onderzoek van (Del Vicario, et al., 2016) dat keek naar de verspreiding van nepnieuws op Facebook. Komen een paar overeenkomsten en verschillen tussen misinformatie en correcte informatie naar voren. Dit onderzoek vergeleek drie categoriën van berichten gedeelt op facebook; ‘wetenschapsnieuws’, ‘conspiracynieuws’ en ‘satire en trollen’. Hierbij wordt alleen conspiracy-nieuws als misinformatie gezien.

Deel-curve

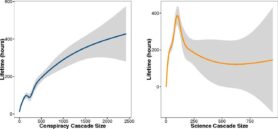

Op Facebook volgt zowel misinformatie als wetenschapsnieuws het zelfde patroon. Gedurende de lifetime van een bericht (de tijd tussen de eerste keer dat een bericht gedeelt wordt en de laatste keer dat een bericht gedeelt wordt) zijn er twee pieken in activiteit. In het begin is er een snelle toename in activiteit tot de eerste hoge piek en na ongeveer 20 uur is er een tweede kleinere piek. (figuur 2) Ongeacht de waarheid van een bericht volgt hij dezelfde curve in het aantal maal dat deze gedeelt wordt.

Voor beide categorieën geldt dat de meeste berichten in de categorie een korte lifetime hadden slechts 26,82% van het wetenschapsnieuws en 17,79% van de conspiracies hadden een lifetime van langer dan een dag. Een vergelijkbaar deel van zowel het wetenschapsnieuws als de conspiracies verdwijnt zelfs binnen twee uur. Dit is beide terug te zien door de sterke daling na de eerste piek (na 2 uur) en de tweede piek (na ongeveer 20+ uur).

Interesse

Uit hetzelfde onderzoek kwam nog een verschil tussen deze twee groepen berichten naar voren. Bij berichten in de categorie ‘conspiracy’ bleek er een positief verband tussen de interesse[10] in het bericht en de lifetime van een bericht. Berichten die erg populair waren werden dus langer gedeelt. Bij berichten in de categorie ‘wetenschapsnieuws’ was dit verband er echter niet. Berichten waar veel interesse in was werden minder lang gedeelt dan berichten waar minder interesse in was.(figuur 3) Bij wetenschapsnieuws werden berichten waar relatief weinig interesse in werd getoond het langste gedeelt. Iets minder interesse en de lifetime is minder, meer interesse en de lifetime is meer uiteenlopend.

Figuur 3 De lifetime van conspiracy- (links) en wetenschapsnieuwsberichten (rechts) uitgezet tegenover hun cascade size. bron: https://www.pnas.org/content/113/3/554

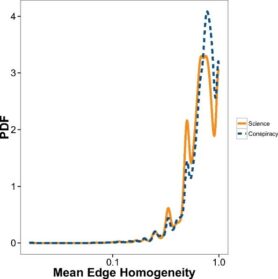

homogeniteit

Verder werd er ook gekeken naar homogeniteit van de delers van de berichten. Dit is groter wanneer meer connecties van een gebruiker dat het bericht deelt, dit bericht ook deelt. Hoewel beide categorieën van berichten vrij homogeen waren was dit voor conspiracy meer dan voor wetenschapsnieuws. (figuur 4) Dit kan erop wijzen dat gebruikers die conspiracies delen meer in een echokamer zitten dan gebruikers die wetenschapsnieuws delen.

De onderzoekers leggen uit dat de kwaliteit van de gedeelde informatie daalt bij hogere een homogeniteit. Dit komt doordat de gebruikers in deze groepen grotendeels dezelfde interesses delen. Er is dan minder feedback van gebruikers met een ander wereldbeeld. Dit werkt terugkoppeling in de hand en laat de mogelijkheid tot confirmation biases groeien. Dit heeft polarisatie en wantrouwen tot gevolgen.

Een andere groep onderzoekers (Resende, et al., 2019) keken naar tekstberichten die gedeelt werden op de messenger-app WhatsApp. Dit OSN verschilt van facebook in het feit dat whatsapp gericht is op een-op-een conversaties of groepsgesprekken terwijl facebook voor een groot deel openbaar is. De onderzoekers hebben in WhatsAppgroepen alle tekstberichten verzameld en deze gecategoriseerd in ‘nepnieuws’ en ‘onbevestigd’.

Lifetime en het effect van de power law

Uit het onderzoek bleek dat berichten met bevestigd nepnieuws langer in WhatsAppgroepen rond bleven gaan. Berichten die bevestigde onwaarheden bevatten hadden een lifetime van tien dagen terwijl andere berichten een kortere lifetime hadden. Wel merken ze op dat dit geld voor tekstberichten, voor afbeeldingen bleek uit een eerder onderzoek met dezelfde database het omgekeerde te gelden.

Ook op WhatsApp bleek dat misinformatie sneller gedeelt werd dan andere informatie. Bovendien is hier de power law weer in terug te zien. 60% van de berichten die ‘onbevestigd’ waren gedeelt door slechts 7 personen. Het is aannemelijk dat deze personen de beste positie in het netwerk hadden om meer informatie te delen. Voor misinformatie werd 60% van de berichten gedeelt door slechts 2 personen. Voor misinformatie lijkt het effect van de power law dus meer aanwezig. Hier heeft een nog kleinere groep de meeste invloed op de misinformatie die verspreid wordt.

Uit deze onderzoeken komt naar voren dat misinformatie zich niet anders gedraagt qua deel-gedrag dan andere informatie in OSN’s. Wel wordt misinformatie langer gedeelt zodra er meer interesse in is, terwijl dit voor wetenschapsnieuws en andere informatie niet geldt. Verder wordt misinformatie meer gedeelt onder groepen met dezelfde interesses dan wetenschapsnieuws. Tot slot geldt de power law sterker voor misinformatie dan voor andere informatie.

Echter lag de focus bij beide deze onderzoeken op misinformatie m.b.t. de politiek en ideologie. De corona-crises brengt wellicht een ander soort nepnieuws met zich mee.

Figuur 2: lifetime van nieuwberichten en conspiracy berichten op facebook

Bron: https://www.pnas.org/content/pnas/113/3/554/F1.large.jpg

Figuur 3: de lifetime van conspiracy- (links) en wetenschapsnieuwsberichten (rechts) uitgezet tegenover hun cascade size.

Bron: https://www.pnas.org/content/113/3/554

Figuur 4: homegeniteit en cascade size

Bron: https://www.pnas.org/content/pnas/113/3/554/F4.large.jpg

9 Medische misinformatie

Een onderzoek van (Waszak, Kasprzycka-Waszak, & Kubanek, 2018) over medische nepnieuws tussen meerdere OSN’s laat dit zien. Dit onderzoek werd in het Pools uitgevoerd. De onderzoekers gingen op zoek naar de meest gedeelde weblinks op sociale media die zich relateerde aan de meest voorkomende doodsoorzaken[11]. Ze hebben vervolgens al deze weblinks gecontroleerd op waarheid. Ze categoriseerde de weblinks volgens; nepnieuws waaronder: ‘gefabriceerd nieuws’, ‘gemanipuleerd nieuws’, ‘adverterend nieuws’; en ook in ‘irrelevant nieuws’ en ‘voldoenend nieuws’.

Hieruit kwam dat wel 40% van de gedeelde weblinks tot nepnieuws behoorde. Bovendien kon meer dan 20% van de gevaarlijke weblinks getraceerd worden tot slechts één bron. Ook als het gaat om medische misinformatie lijkt er dus sprake van een sterke effect van de power law.

Niet alle aandoeningen lijken echter op het coronavirus. Het meest vergelijkbare is HIV, ook een virus. Van de top 10 gedeelde links over AIDS en HIV bleken 7 van de 10 nepnieuws. Mocht er een een vaccin komen voor het coronavirus dan kan daar ook nepnieuws van verwacht worden; 9 van de 10 meest gedeelde weblinks over vaccinaties bleek nepnieuws te zijn. Ter vergelijking, van kanker was dit 5/10, tumoren 2/10, diabetes 3/10 en hoge bloeddruk 7/10.

10 Conclusie

Samenvattend, misinformatie rondom het coronavirus is niet een opzichzelfstaand fenomeen. Rondom voorgaande epidemieën ging er ook misinformatie rond en dat heeft ernstige gevolgen gehad. Ook rond COVID-19 heeft misinformatie al zeker een slachtoffer teweeg gebracht. Om meer ernstige gevolgen van nepnieuws te voorkomen is het belangrijk dat correcte informatie mensen bereikt voordat misinformatie dat doet.

Misinformatie verspreidt zich sneller dan correcte informatie, blijft langer gedeelt worden en heeft minder interesse nodig dan correcte informatie. In echokamers, groepen gebruikers met dezelfde interesses, zijn deze effecten versterkt. In deze subnetwerken is er minder controle van feiten doordat de gebruikers in deze groepen hun wereldbeeld alsmaar bevestigd zien worden. (confirmation bias) Ook als het gaat over medische nepnieuws zijn in deze groepen slechts een klein aantal gebruikers de bron van het grootste deel van de misinformatie. Daarnaast kunnen berichten die veel gedeelt worden op den duur veranderen.

11 Discussie

Hoewel er door de komst van sociale media iedereen nu een redacteur is geworden van zijn eigen dagblad, blijft het risico op nepnieuws door een kleine groep groot. Ditmaal niet van een hoofdredacteur die aan de top staat en kiest welk beeld hij wilt schetsen, maar door de power law die stelt dat sommige mensen in een sociaal netwerk nou eenmaal meer invloed hebben dan andere. In zo een situatie moeten we meer doen dan alleen hopen dat de mensen in die posities zich verantwoordelijk gedragen.

Ook in Nederland, Europa en de wereld is er een risico op een tweede golf corona-patiënten indien we ons teveel laten beïnvloeden door nepnieuws. Bij de Ebola-uitbraak zorgde dit voor een vertienvoudiging van het aantal patiënten in Guinee. Hoewel ik niet verwacht dat de situatie dit keer zover uit de hand zal lopen[12], moeten we wel waakzaam zijn. Naast de verhalen over wondermiddelen tegen corona, die schadelijk kunnen zijn, schat ik in dat er ook over een toekomstig preventiemiddel in de vorm van een vaccinatie nepnieuws zal zijn.

Nepnieuws en misinformatie verspreiden zich voornamelijk binnen echokamers, maar binnen deze subnetwerken zijn er slechts een klein aantal gebruikers die het grootste deel van de gedeelde misinformatie verspreiden. Het is de vraag of het mogelijk is om dit te stoppen. Naast dat het lastig kan zijn om zo een gebruiker ervan te overtuigen dat wat er gedeeld wordt incorrect en schadelijk is, is er ook een kans dat er gewoonweg andere gebruikers komen die dezelfde rol overnemen.

Een goede manier om de schade van misinformatie te beperken lijkt mij door gebruikers correcte informatie te geven voordat ze de misinformatie tegenkomen. Ik geloof dat wij als studenten met toegang tot een boel wetenschappelijke informatie hier een grote rol in kunnen spelen. Hoewel het een grote en enge verantwoordelijkheid is.

Enkele grote OSN-platformen waarop misinformatie verspreid wordt hebben al maatregelen genomen. Google en dochterbedrijf YouTube tonen bij alles waarbij ze vermoeden dat het corona gerelateerd is al informatie van gezondheidsinstanties en betrouwbare nieuwsbronnen over het virus. Twitter, Facebook en Amazon geven advertentieruimte weg aan organisaties. (Waddel, 2020) Daarnaast nemen ze nog meer maatregelen.

Ik vermoed dat dit soort maatregelen voor de messenger-OSN’s lastiger zal zijn. Die kenmerken zich door hun privé gesprekken en hun gebruikers zouden waarschijnlijk raar opkijken als het bedrijf direct communiceert met zijn gebruikers via de apps. Ze zijn immers al huiverig over advertenties in hun apps. Berichten controleren gaat ook niet, juist omdat de correspondenties privé zijn. Op dit gebied moeten we elkaar dus scherp houden.

12 Eindconclusie

Voor ons onderzoek gedurende blok 4 is het handig om rekening te houden met de volgende dingen. In elk (sub)netwerk zijn er slechts een aantal gebruikers die het grootste deel van de nepnieuws verspreiden. Een goed beeld van hun berichten geeft dus een aardige beeld van hun subnetwerk. Andersom zal een subnetwerk waarschijnlijk gedomineerd worden door berichten die zijn te herleiden tot een aantal gebruikers. Als het gaat om misinformatie lijkt dit effect versterkt. Verder volgen beide misinformatie en correcte informatie hetzelfde patroon qua deel gedrag. Voor beide geldt dat een groot deel van de berichten niet langer dan 2 uur worden gedeelt en de meeste niet langer dan een dag. Berichten met misinformatie waar veel interesse voor is (je zou kunnen zeggen hype) worden langer gedeelt, terwijl berichten met correcte informatie waar veel interesse voor is niet per se langer worden gedeelt.

Hierom stel ik voor om bij het close-reading deel van het onderzoek te kijken naar de berichten waar veel interesse in is. Het liefst ook een bericht die komt van een bron in het netwerk met veel invloed, deze zou geïdentificeerd kunnen worden a.d.h.v. een frequentie analyze op een groot deel van de berichten in een subnetwerk. Mocht dit niet lukken kunnen we er rekening mee houden dat berichten met weinig participatie waarschijnlijk niet representatief zijn voor het hele subnetwerk.

13 Verwijzingen

Allport, G., & Postman, L. (1947). The psychology of rumor. In H. Holt, The psychology of rumor (p. 247). Oxford: Heny Holt and Company.

Andrews, E. (2019, oktober 9). How fake news spreads like a real virus. Opgehaald van Stanford Engineering: https://engineering.stanford.edu/magazine/article/how-fake-news-spreads-real-virus

Castillo, C., Mendoza, M., & Poblete, B. (2011). Information Credibility on Twitter. Proceedings of the 20th international conference on World wide web (pp. 675-684). New York: Association for Computing Machinery.

Del Vicario, M., Bessi, A., Zollo, F., Petroni, F., Scala, A., Caldarelli, G., . . . Quattrociocchi, W. (2016). The Spreading of misinformation online. National Academy of Sciences, 554-559.

Faloutsos, M., Faloutos, P., & Faloutsos, C. (1999). On Power-Law Relationships of the Internet Topology. Computer Communication Review, 251-262.

Gans, H. (1979). Deciding What’s News. New York: Pantheon Books.

Gans, H. (1979). The messages behind the news. Columbia Journalism Review, 17(5), 40.

Mian, A., & Khan, S. (2020). Coronavirus: the spread of misinformation. BMC Medicine, 1-2.

Mossa, S., Barthélémy, M., Stanley, E., & Nunes Amaral, L. (2002). Truncation of Power Law Behavior in “Scale-Free” Network Models due to Information Filtering. Physical Review Letters, 138701/1-138701/4.

Nguyen, N., Yan, G., Thai, M., & Eidenbenz, S. (2012). Containment of Misinformation Spread in Online Social Networks. Proceedings of the 4th Annual ACM Web Science Conference (p. 213). New York: Association for Computing Machinery.

Resende, G., Melo, P., Reis, J., Vasconcelos, M., Almeida, J., & Benevenuto, F. (2019). Analyzing Textual (Mis)Information Shared in WhatsApp Groups. Proceedings of the 10th ACM Conference on Web Science (pp. 225-234). New York: Association for Computing Machinery.

Silverstein, B. (1987). Toward a Science of Propaganda. Political Psychology, 49-59.

Sosnovsky, S. (2020, februari 5). Brief History of the Web. Utrecht, Utrecht, Nederland.

Stern, J. E. (2014, september 2). Hell in the Hot Zone. Opgehaald van Vanityfair: https://www.vanityfair.com/news/2014/10/ebola-virus-epidemic-containment

The Guardian. (2020, maart 24). Arizona man dies after attempting to take Trump coronavirus ‘cure’. Opgehaald van The Guardian: https://www.theguardian.com/world/2020/mar/24/coronavirus-cure-kills-man-after-trump-touts-chloroquine-phosphate

US Centers for Disease Control and Prevention. (2019, april 3). Ebola (Ebola Virus Disease) 2014 Ebola Outbreak in West Africa Epidemic Cruves. Opgehaald van Centers for Disease Control and Prevention: https://www.cdc.gov/vhf/ebola/history/2014-2016-outbreak/cumulative-cases-graphs.html

US Centers for Disease Control and Prevention. (2019, November 5). Ebola (Ebola Virus Disease) symptoms. Opgehaald van Centers for Disease Control and Prevention: https://www.cdc.gov/vhf/ebola/symptoms/index.html

Waddel, K. (2020, maart 11). Fight Against Coronavirus Misinformation Shows What Big Tech Can Do. Opgehaald van bridgeportedu: https://www.bridgeportedu.net/cms/lib/CT02210097/Centricity/Domain/3754/Costello_Journalism_11_3_23.3_31.pdf

Waszak, P., Kasprzycka-Waszak, W., & Kubanek, A. (2018). The spread of medical fake news in social media – The pilot quantitative study. Health Policy and Technology, 115-118.

[1] Benaming voor Spanje onder Franco

[2] Vrije vertaling vanuit het Engels: “The media could have called the young men who refused to serve in the Vietnam War draft evaders, dodgers or risters,” (Gans H. , 1979)

[3] “We want to to make sure that most of the network users are aware of the good information by the time the bad one reaches them.” (Nguyen, Yan, Thai, & Eidenbenz, 2012)

[4] ‘ “rebels dressed in yellow who attacked Guinea and then disappeared”—the interpretation of a local journalist trying to make sense of all the people in big yellow protective suits who had suddenly descended on the country. ’ (Stern, 2014)

[5] De incubatietijd, de lengte van de periode tussen het oplopen van het virus en het tonen van de eerste symptomen bij een patiënt, bedragen bij ebola hoogstens 21 dagen na contact met het virus. (US Centers for Disease Control and Prevention, 2019)

[6] Web 1.0 (1989-2003) was voornamelijk voor mensen met maar relatief klein aantal auteurs. Web 2.0 (2004-2011) bracht daar verandering in. Mede door de opkomst van OSN’s kreeg het WWW plots veel meer auteurs. Inmiddels zitten we in Modern Web (2011- … waarbij zelfs algoritmes content consumeren en produceren voor het web. (Sosnovsky, 2020)

[7] “The so-called “power law’” of social media, a well-documented pattern in social networks, holds that messages replicate most rapidly if they are targeted at relatively small numbers of influential people with large followings.”

[8] Waarbij een verhaal of een zin wordt doorgefluisterd van persoon A naar persoon B en persoon van persoon B naar persoon C tot de laatste persoon in de ketting die het verhaal probeert te herhalen.

[9] Hiervoor gebruikte Resende et al de Jaccards gelijkheidscoëfficiënt en beschouwde ze berichten met een geleikheidsscore vanaf 0,7 als het zelfde bericht.

[10] Aangegeven bij cascade size.

[11] Ze gerbuikten als zoektermen: cancer, neoplasm, heart attack, stroke, hypertension, diabetes, vaccinations, HIV, and AIDS.

[12] COVID-19 heeft immers een kortere incubatietijd dan het Ebolavirus.